Comment les algorithmes façonnent nos opinions

Republike face aux algorithmes ! Les réseaux sociaux constituent désormais le vecteur d’information primordial de toute une génération d’internautes. Ces plateformes vivent de l’économie de l’attention grâce aux revenus publicitaires. Nous allons nous intéresser au fonctionnement de leurs algorithmes, et présenter leurs défauts. Puis nous partirons découvrir le modèle disruptif proposé par Republike, le média social dont les utilisateurs sont propriétaires.

Le Journal du Coin vous propose cet article promotionnel en collaboration avec Republike.

Façonner le comportement de la donnée grâce aux algorithmes

Les algorithmes des médias sociaux sont conçus pour mettre en avant le contenu générant le plus d’engagement. C’est cet engagement qui, en drainant les données des utilisateurs, génère le revenu des plateformes. C’est ce qu’on appelle l’économie de l’attention. Tout ce modèle économique repose sur la monétisation de celle-ci. Pour faire simple, plus l’utilisateur consomme de temps d’écran, plus il vaut cher.

Qu’il s’agisse de Facebook, de X ou d’Instagram, les contenus qui reçoivent le plus de likes, de partages et de commentaires sont favorisés. Et ceci, indépendamment de leur qualité réelle. Les systèmes de recommandation composent donc les flux de contenu en fonction des interactions de l’utilisateur. Plus il interagit avec un certain type de contenu, et plus il aura de chances de le voir apparaître sur son fil. Ce modèle économique est conçu pour capter au maximum et par (presque) tous les moyens l’attention. Ceci afin de la revendre ensuite aux publicitaires.

À première vue, cela paraît raisonnable pour mettre en avant du contenu de qualité. En quelque sorte, les algorithmes se basent sur la sagesse des foules. Nous souhaitons tous accéder à des informations fiables, obtenir les avis et opinions d’experts, ou à du contenu divertissant. L’utilisation de l’intelligence collective permettrait de sélectionner le contenu à mettre en avant sur les médias sociaux, en fonction des préférences des utilisateurs. Le contenu qualitatif aurait donc plus de chances de devenir viral.

Cependant, comme nous allons le voir, il est aujourd’hui certain que ce système produit l’effet inverse. Ces algorithmes ont plutôt tendance à diminuer la qualité des contenus proposés, à favoriser la diffusion de fausses nouvelles et à frustrer les utilisateurs.

Les algorithmes se jouent-ils de nos biais cognitifs ?

En 2021, Frances Haugen, ancienne cheffe de produit chez Facebook, qualifiait devant le sénat américain son algorithme de dangereux. Ces systèmes de recommandation et de curation seraient même en passe de « nuire aux enfants, attiser la division et affaiblir la démocratie. »

Plus tôt, en 2017, Chamath Palihapitiya, vice-président de l’acquisition utilisateurs chez Facebook de 2007 à 2011, pointant les effets à long terme de ce modèle, affirmait devant les étudiants de Stanford :

« Je crois que nous avons créé des outils qui sont en train de déchirer le tissu social qui définit le fonctionnement de la société. […] Il n’y a plus de discours civil ni de coopération, et la désinformation et les fake news se propagent. Ce n’est pas un problème américain, cela n’a rien à voir avec les publicités russes. C’est un problème mondial. ».

Chamath Palihapitiya

Il y a plusieurs points à étudier pour comprendre comment les algorithmes peuvent manipuler nos opinions. Tout d’abord, la mise en avant des contenus les plus populaires est loin d’assurer leur qualité. On parle de biais de popularité. Le phénomène est le suivant : lorsque peu de personnes ont été exposées à un élément, leur engagement génère un signal biaisé – du “bruit”. L’algorithme s’occupera ensuite de l’amplifier. Une fois que la popularité d’une information de mauvaise qualité a atteint une taille critique, elle continue de s’amplifier. Plusieurs chercheurs ont démontré que le biais de popularité est préjudiciable à la qualité du contenu.

Une contagion savamment orchestrée

Le phénomène dit de contagion complexe est également une source de danger pour notre cerveau. Plus un utilisateur est exposé à une idée ou une information, et plus il a tendance à l’adopter et à la partager. Même en usant d’esprit critique, c’est un biais cognitif qui reste très puissant.

Ceci est accentué par les algorithmes de recommandation qui vont pousser aux utilisateurs des contenus similaires une fois identifié ce qui les fait réagir (les “engage”), faisant naître une autre dérive cognitive, le biais de confirmation. Il se définit comme le renforcement de nos propres convictions par la confirmation issue des interactions avec des contenus, tendances ou opinions de même nature. Ce biais a un rôle considérable dans la polarisation et la “balkanisation” des opinions sur les réseaux sociaux.

Enfin, toujours dans l’optique de maximiser l’engagement, les contenus à caractère sensationnel sont naturellement privilégiés. Cela se traduit encore dans les propos de Chamath Palihapitiya :

« Les cercles vicieux alimentés par de petites doses de dopamine que nous avons créées sont en train de détruire la société ».

Chamath Palihapitiya

Ainsi, une fake news peut tout à fait devenir virale, et se diffuser largement auprès de la population. D’autant plus qu’il a été démontré par une étude du MIT portant sur 126 000 tweets diffusés entre 2006 et 2017 que la propagation des fake news est six fois plus rapide que celle des faits avérés. Cela touche potentiellement jusqu’à 100 000 personnes contre un millier pour les tweets authentiques.

C’est un fait avéré, un tweet factuel peine à franchir la barrière des 10 partages. La désinformation, elle, se voit amplifiée par jusqu’à 19 relayeurs successifs.

L’infiltration de bots sur de nombreuses plateformes vient “exponentialiser” cette dynamique..

Les limites du paradigme

Les algorithmes peuvent donc favoriser la désinformation, car les utilisateurs ont tendance à liker et partager le contenu en fonction des métriques d’engagement, et non de leur analyse rationnelle. De même, ils encouragent les comportements grégaires et l’homogénéisation des contenus. Cela engendre plusieurs problèmes :

- Polarisation des débats ;

- Violence et censure ;

- Diffusion de contenus peu qualitatifs ou erronés ;

- Expérience utilisateur frustrante ;

- Comportements addictifs.

En s’attaquant à la racine même du problème, le modèle de l’économie de l’attention généré par les algorithmes, Republike propose une plateforme novatrice. Partant du constat que tant que l’attention demeure la source de financement des plateformes il est structurellement illusoire de prétendre sortir de ces dérives, Republike repose sur un modèle de souscription annuelle qui redistribue la valeur aux utilisateurs. En supprimant de fait la dépendance financière à l’attention des utilisateurs, Republike a pu redéfinir radicalement la notion d’engagement et proposer un design où l’utilisateur devient responsable de la qualité des contenus et garant du respect de valeurs humaines universelles.

La vision de Republike

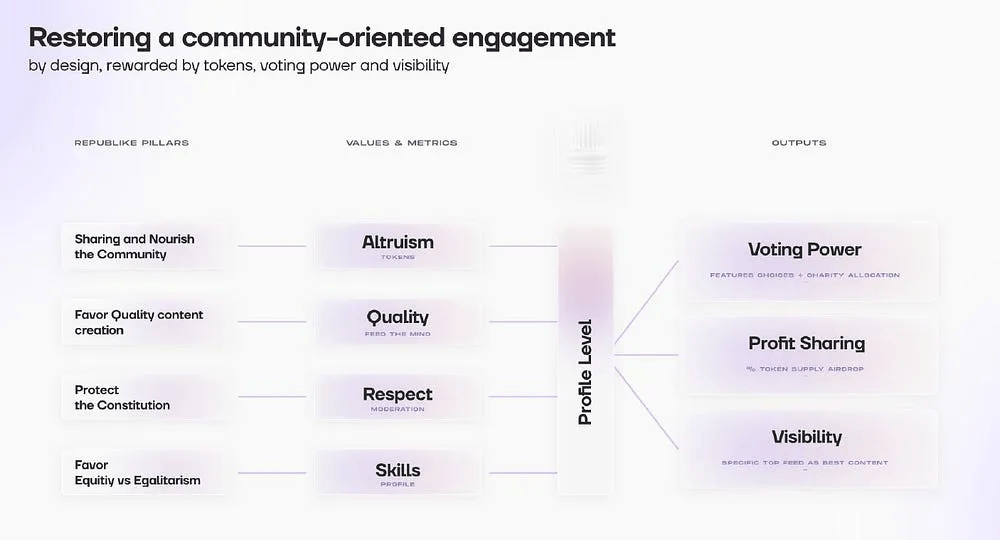

Dans les faits, Republike est avant tout la première itération d’un tout nouveau modèle, où le média social est indépendant de l’économie de l’attention. La nouvelle définition de l’engagement permet d’aligner les récompenses individuelles sur le respect des valeurs de la communauté. Ces valeurs (respect, altruisme, qualité et compétence) se traduisent dans les fonctionnalités et se mesurent concrètement au travers des interactions des membres du réseau.

Comment l’algorithme de Republike mesure-t-il les valeurs communautaires ?

L’algorithme de Republike combine différentes métriques pour déterminer le niveau de profil d’un membre. Les valeurs sont validées lors de l’inscription sur la plateforme, et énoncées dans sa Constitution :

- Respect : La modération est conçue pour évaluer le contexte émotionnel (l’intention) sous-jacent au contenu posté, plutôt que la nature du contenu lui-même. La métrique respect dépend ensuite du pourcentage de modération dans la direction de la majorité.

- Altruisme : il est mesuré en fonction des récompenses (pourboires et dons) attribuées aux autres membres en micro fractions de tokens reçus à la souscription et aux distributions régulières.

- Qualité : elle est un produit de l’engagement généré (likes, commentaires) sur le nombre total de contenus postés sur la plateforme, et non rejetés par la modération.

- Compétences spécifiques : elles sont évaluées (version cible) grâce au nombre de votes positifs nets pour les contenus postés par catégorie ou par hashtag.

Mécanismes de récompense

Les rétributions sont ensuite de trois types :

- Profit financier ;

- Pouvoir de vote dans la gouvernance ;

- Visibilité.

C’est un modèle qui promeut l’équité : en effet, il encourage chacun à être responsable et authentique. L’utilisateur devient acteur de la modération du contenu. Ce système est à l’opposé du modèle égalitaire classique, où les utilisateurs sont avant tout mus par l’instinct grégaire et poussés dans cette direction par la mécanique algorithmique.

Le pay-to-own

Les utilisateurs de Republike paient un abonnement annuel qui leur octroie des tokens utilitaires (AURE) qui représentent une réserve de valeur liée à l’évolution du projet. Dans la version cible, le capital de la plateforme prendra la forme d’une tokenisation. Les utilisateurs investissent donc dans la maintenance et le développement de Republike, tout en étant incités à agir individuellement dans l’intérêt collectif.

En combinant ce nouveau modèle d’engagement, le système de modération, le financement participatif de la plateforme et le partage de la valeur créée, Republike propose une alternative très solide à l’économie de l’attention en s’attaquant directement à ses points faibles.

Amenés à devenir propriétaires de la plateforme dans la version cible (Republike qui est actuellement en phase de réservation et n’est accessible directement que sur invitation, ouvre sa version bêta au public le 22/2) et n’ayant pas accès au partage de valeur s’ils n’en respectent pas la constitution, ses utilisateurs sont ainsi responsabilisés au maximum. Ils sont ainsi encouragés à participer à la co-construction du projet qui n’en est qu’à ses débuts. Ce nouveau modèle économique permettra-t-il de sortir du paradigme classique des algorithmes, focalisé sur le ciblage des individus et les revenus publicitaires ?